Les informations non structurées |

|

Présentation de la leçon

Dans la présente leçon, nous définirons d’abord les trois grands types d’informations (structurées, non structurées et semi-structurées) et traiterons ensuite de la problématique de la surcharge d’informations qui caractérise les informations non structurées.

L’information non structurée, qu’est-ce que c’est ? Contrairement à ce qu’on pourrait penser, ce n’est pas de l’information mal organisée, mais plutôt de l’information qui ne peut pas être traitée facilement par un ordinateur. Un document Word est un exemple d’information non structurée dans la mesure où il est difficile pour l’ordinateur d’en traiter le contenu. À l’opposé de l’information non structurée, on trouve les bases de données informatiques. L’information structurée est généralement créée par des informaticiens ou des logiciels, et sa gestion est relativement aisée. L’information non structurée est beaucoup plus difficile à gérer et relativement abondante : le web est un exemple d’information non structurée (ou semi-structurée). On cherche d’ailleurs à transformer le web en un web sémantique qui contiendrait davantage d’information structurée

Introduction

Il importe d’abord de distinguer les informations de la connaissance (dans le cadre du présent cours, nous ne traiterons qu’indirectement de cette dernière). Les informations existent en elles-mêmes, sans l’être humain, alors que la connaissance s’acquiert par un processus cognitif. Par ailleurs, tandis qu’on peut parler d’informations d’un point de vue strictement informatique, la connaissance est un sujet qui requiert le concours de la psychologie, de la philosophie et de plusieurs autres disciplines.

1. Types d’informations

En informatique, les informations se divisent en trois types : les informations structurées, non structurées et semi-structurées. Les deux derniers cas, qui constituent l’objet du cours, représentent un problème plus complexe qui constitue un domaine appelé « la recherche d’informations » (Information Retrieval). Nous présentons et définissons ces types d’informations ci-après.

1.1 Informations structurées

Nous trouvons les informations structurées dans les bases de données et les langages informatiques. Nous reconnaissons les informations structurées au fait qu’elles sont disposées de façon à être traitées automatiquement et efficacement par un logiciel, mais non nécessairement par un humain.

La ligne de code Java

int salaire = 60000; String nom="Jean";

est un exemple simple d’informations structurées : nous connaissons les valeurs, dont le nom est associé à la fonction. Nous pouvons ici supposer que le nom de l’individu est Jean et que son salaire est de 60 000 dollars.

Par opposition, la chaîne de caractères « Jean gagne un salaire de 60 000 dollars » n’est pas structurée, car nous ne pouvons nous attendre à ce qu’un logiciel puisse lire et comprendre une phrase écrite en français.

Le plus souvent, nous disposons les informations structurées dans des tableaux, comme dans une base de données relationnelle [1]. Voici un exemple d’informations structurées présentées dans un tableau :

| Étudiant | Note | |||

|---|---|---|---|---|

| Jean | 75 | |||

| Marie | 85 |

| Unité | Valeur |

|---|---|

| demi-octet | 4 bits |

| octet | 8 bits |

| kilo-octet (Ko) | 1000 octets |

| kibioctet (Kio) | 1024 octets |

| mégabit (Mbit) | $10^6$ bits |

| mébibit (Mibit) | $2^20$ bits |

| mégaoctet (Mo) | $10^6$ octets |

| mébioctet (Mio) | $2^20$ octets |

| gigaoctet (Go) | $10^9$ octets |

| gibioctet (Gio) | $2^30$ octets |

| téraoctet (To) | $10^12$ octets |

| tébioctet (Tio) | $2^40$ octets |

| pétaoctet (Po) | $10^15$ octets |

| pébioctet (Pio) | $2^50$ octets |

| nombre d’électrons dans l’univers | $10^79$ |

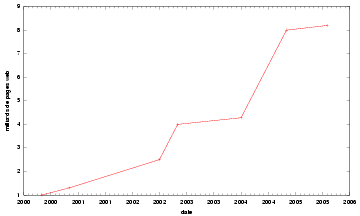

Les capacités de stockage augmentent sans cesse et deviennent de moins en moins coûteuses. Les architectures informatiques courantes se divisent généralement en stockage interne (RAM) et en stockage externe (p. ex. disques rigides). Le tableau suivant donne la capacité de stockage d’un ordinateur en 1993, en 1998, en 2004 et en 2014 :

Tableau II

Espace de stockage d’un ordinateur de 1993 à 2014

| 1993 | 1998 | 2004 | 2014 | |

| Interne | 4 Mo | 16 Mo | 256 Mo | 4 Go |

| Externe | 100 Mo | 1 Go | 100 Go | 1To |

Nous constatons sans mal que la capacité de stockage de nos ordinateurs personnels augmente de façon exponentielle. En dix ans, la capacité de stockage interne a été multipliée par 64, alors que la capacité de stockage externe a été multipliée par 1000 [8]. Nous pouvons également considérer l’exemple des disques optiques. Le cédérom, qui date de 1985, permet de stocker 650 Mo ; dix ans plus tard, en 1995, le DVD-ROM a une capacité qui varie de 4,7 Go à 17,1 Go, alors que le Blu-Ray (2003) offre une capacité de stockage de 25 Go, soit l’équivalent de 40 cédéroms. Dans la même période, en appliquant la loi de Moore, le nombre de transistors par unité d’aire dans nos microprocesseurs a été multiplié par 45. Nous constatons donc que la capacité de stockage externe s’accroît à un rythme beaucoup plus élevé que la capacité de stockage interne ou que le nombre de transistors par unité d’aire. Nous nous dirigeons sans doute vers un monde où les capacités de stockage seront infinies. En effet, selon Gray [9], un enregistrement de tout ce que vous pouvez lire occuperait 25 Mo par an ; un enregistrement de tout ce que vous pouvez entendre occuperait 100 Go par an ; alors qu’un enregistrement de tout ce que vous pouvez voir occuperait 10 To par an. Ainsi, nous pouvons penser que dès que des disques ayant une capacité de 10 To seront à des prix très abordables, nous aurons effectivement une capacité de stockage « infinie » dans la mesure où le coût de stockage n’aura plus aucune importance.

La capacité de stockage n’est qu’une partie du problème ; il faut aussi examiner la vitesse de lecture des informations stockées. Deux facteurs permettent de mesurer la vitesse de lecture : le temps d’accès et le taux de transfert (ou bande passante). Le taux de transfert est la vitesse de lecture des données en séquence : dans un disque rigide, cette vitesse correspond un peu à la vitesse de l’aiguille au-dessus du disque magnétique, qui est elle-même déterminée par la vitesse de rotation du disque. Le taux de transfert s’exprime en octets ou bits par seconde (Ko/s, Mo/s, etc.). Le temps d’accès est le délai moyen qu’il faut pour trouver et commencer à lire une section de mémoire. Ce délai s’exprime souvent en millisecondes (ms) ou en nanosecondes (ns) : dans un disque rigide, cette vitesse est fonction de la vitesse à laquelle on peut placer l’aiguille à la bonne position au-dessus du disque magnétique. La latence (temps d’attente) est le résultat de la somme du temps d’accès et de la quantité d’informations à lire divisée par le taux de transfert.

latence = temps d’accès + quantité d’informations / taux de transfert

Par exemple, le temps nécessaire pour télécharger un site web comprend le temps nécessaire pour trouver le serveur web (temps d’accès) et le temps nécessaire pour télécharger la page (la taille de la page divisé par le taux de transfert). Même si la page web a télécharger est très petite, si le temps d’accès est élevé (recherche du serveur et connexion), la latence peut être tout de même élevée.

Il est intéressant d’observer qu’il y a un lien direct entre les capacités de stockage et le taux de transfert. Dans le pire des cas, je peux acheter des disques physiques, les charger dans une voiture et rouler de Montréal à Québec. La latence sera élevée, mais le taux de transfert pourrait être important.

3. Les outils de traitement des informations non structurées

3.1 WebFountain

Plusieurs outils permettent de traiter les informations non structurées. L’un des plus célèbres est sans doute WebFountain d’IBM. L’objectif de WebFountain est de pouvoir traiter le grand volume de données non structurées trouvées sur le web. L’intérêt de l’outil est de pouvoir cataloguer et analyser les informations non structurées de façon continue (en temps réel) pour y trouver des tendances, des motifs récurrents et des relations. En y mettant le prix, nous pouvons utiliser WebFountain à l’aide de compagnies comme Factiva. WebFountain utilise notamment l’algorithme HITS que nous étudierons plus tard dans ce cours.

3.2 Echelon

ECHELON est un système d’interception et de traitement de données opéré par les services secrets américains. ECHELON intercepte les conversations téléphoniques, les courriels, les requêtes diverses, etc., à des fins d’espionnage et de contre-espionnage. Les quantités de données traitées sont probablement colossales. Il s’agit sans doute du plus important système de traitement de données non structurées à des fins d’espionnage au monde.

3.3 YouTube

YouTube est un site web entreposant des millions d’extraits vidéos. La particularité du site est que tout le monde peut y déposer un extrait vidéo. Fondé en février 2005, le site a été vendu à Google en octobre 2006 pour la rondelette somme de 1,65 milliard de dollars.

YouTube appartient à une tendance appelée parfois « Web 2.0 » qui désigne les sites web comme Wikipédia ou les blogues dont le contenu provient des utilisateurs qui peuvent communiquer directement le fruit de leurs travaux.

3.4 Outils pour votre bureau

Les nouveaux systèmes de fichiers, comme WinFS et ReiserFS, incorporent les techniques avancées de gestion des informations dans les systèmes d’exploitation communs comme Windows, MacOS et Linux.

4. Pour terminer la leçon, un tableau...

On peut estimer le prix d’un téraoctet de stockage à environ 50 $. Le tableau suivant donne une estimation des quantités d’information ainsi que le prix d’achat des unités de stockage correspondantes. Notons que le prix exclut les coûts d’acquisition et de traitement des données.

Tableau V

Espace de stockage requis et coût approximatif correspondant

| Totalité des informations | 12 000 000 To | 600 millions $ |

| Enregistrement vidéo pendant un an | 10 To | 500 $ |

| Enregistrement audio pendant un an | 100 Go | 5 $ |

[1] Une base de données relationnelle est une base de données structurées suivant les principes de l’algèbre relationnelle.

La théorie des bases de données relationnelles est attribuée à Codd.

La plupart des moteurs de bases de données utilisés en technologie de l’information sont relationnels : SQL Server, Oracle, MySQL, PostgreSQL, etc.

[2] La première partie du courriel contient une séquence de lignes au format « quelquechose : autrechose », puis se termine par une ligne vide. Nous verrons qu’il est très facile de traiter ce type de texte qui suit un modèle aussi simple en utilisant des expressions régulières. Nous aborderons ce sujet plus tard dans le cours.

[3] On pourrait faire valoir que, dans un courriel, la ligne « From : Jean Couture

[4] Taxonomie : classification d’éléments concernant un domaine.

[5] Alvin Toffler et Heidi Toffler, Revolutionary Wealth, New York, Knopf, 2006, ISBN : 0375401741.

[6] Par indexer, on entend « rendre facile à trouver rapidement » : Eric Schmidt fait ici référence aux « index inversés » utilisés par les moteurs de recherche pour rendre les recherches plus rapides. Nous traiterons cette question plus tard dans le cours.

[7] Quelle portion de la population achète et vend de l’or de nos jours ? Pourtant, on donne cette information tous les soirs au téléjournal de Radio-Canada !

[8] Cet accroissement considérable de la capacité de stockage des disques est en bonne partie attribuable à la découverte de la magnétorésistance géante en 1998 pour laquelle Fert et Gruenberg ont obtenu le prix Nobel de physique en 2007.

[9] Jim Gray, What Next ? A Dozen Information-Technology Research Goals, Journal of the ACM, vol. 50, no 1, janvier 2003.